미국 경찰은 바디캠으로 소리를 녹음하는 기술을 사용해 8초 안에 사건 보고서를 작성합니다.

미국의 일부 경찰서에서는 인공지능(AI) 챗봇을 사용하여 사건 보고서의 첫 번째 초안을 작성하는 실험을 하고 있습니다.

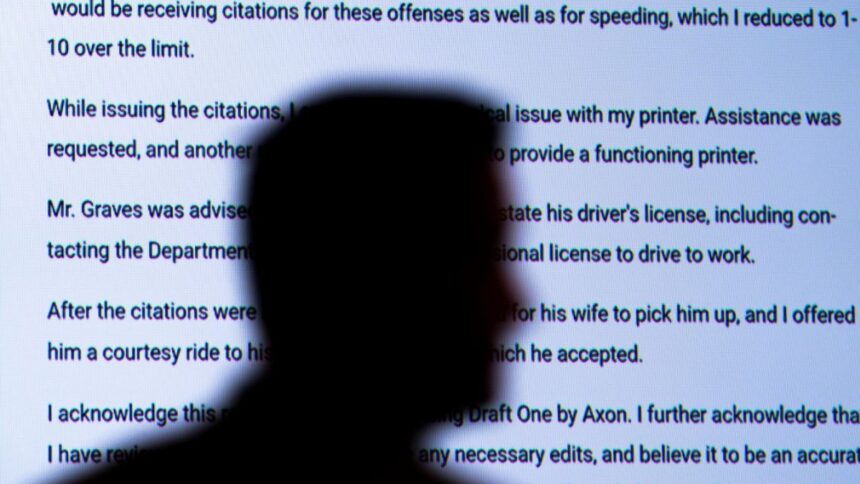

ChatGPT와 동일한 생성 AI 모델을 사용하는 기술 중 하나는 경찰의 바디 카메라에 있는 마이크에서 소리와 무선 대화를 끌어내 8초 안에 보고서를 작성할 수 있습니다.

“제가 쓸 수 있는 것보다 더 나은 보고서였고 100% 정확했습니다. 흐름도 더 좋았습니다.” 오클라호마 시 경찰의 경찰 상사인 맷 길모어가 말했습니다.

새로운 도구는 미국 경찰이 이미 사용 중인 확장된 AI 툴킷의 일부가 될 수 있습니다. 여기에는 자동차 번호판을 읽고, 용의자의 얼굴을 인식하고, 총소리를 감지하는 알고리즘이 포함됩니다.

AI 보고서 사용 방법에 대한 몇 가지 지침

AI 제품인 드래프트 원을 개발한 회사인 액슨(Axon)의 CEO 겸 설립자인 릭 스미스는 AI가 경찰이 해야 하는 서류 작업을 없앨 가능성이 있어, 원하는 업무에 더 많은 시간을 할애할 수 있다고 말했습니다.

하지만 스미스는 경찰이 사용하는 다른 AI 기술과 마찬가지로 우려 사항이 있다는 것을 인정했습니다.

그는 이런 증언은 주로 경찰이 범죄 현장에서 본 것에 대해 형사 소송에서 증언해야 하는 경우를 대비해 보고서에 무엇이 들어 있는지 확인하고자 하는 지방 검사에게서 나온다고 말했습니다.

스미스는 “그들은 증언대에 선 경찰관이 ‘AI가 썼지 내가 쓴 게 아니야’라고 말하는 걸 결코 원하지 않는다”고 말했습니다.

AI가 생성하는 경찰 보고서의 도입은 너무나 새로운 일이어서 이를 사용하도록 안내하는 지침이 거의 없거나 전혀 없습니다.

오클라호마 시에서는 해당 도구를 지역 검사에게 보여주었고, 검사들은 위험도가 높은 형사 사건에 이 도구를 사용하기 전에 주의해야 한다고 조언했습니다.

하지만 미국 내 다른 지역에서는 경찰이 어떤 사건에든 또는 적합하다고 판단되는 대로 해당 기술을 사용할 수 있는 도시도 있습니다.

AI 인종적 편견에 대한 우려

법학자 앤드류 퍼거슨은 이 기술이 시행되기 전에 이 기술의 이점과 잠재적 피해에 대한 대중의 논의가 더 많아지기를 바랍니다.

첫째, AI 챗봇의 기반이 되는 대규모 언어 모델은 잘못된 정보를 조작하는 경향이 있어 문제가 됩니다. 환각으로 알려진 경찰 보고서에 설득력 있고 알아차리기 어려운 거짓을 추가할 수 있습니다.

“자동화와 기술의 편리함으로 인해 경찰관들이 글을 쓸 때 덜 조심하게 될까 봐 우려됩니다.”라고 American University의 법학 교수인 Ferguson은 말했습니다. 그는 떠오르는 기술에 대한 최초의 법률 리뷰 기사를 작업하고 있습니다.

퍼거슨은 경찰 보고서가 경찰의 의심이 “누군가의 자유 상실을 정당화하는지”를 판단하는 데 중요하다고 말했습니다. 그것은 때때로 판사가 보는 유일한 증언이며, 특히 경범죄의 경우 더욱 그렇습니다.

퍼거슨은 인간이 생성한 경찰 보고서에도 결함이 있다고 말하면서도 어느 보고서가 더 신뢰할 만한지는 아직 불분명하다고 덧붙였다.

AI 기술에 사회의 인종적 편견과 선입견이 내장될 수 있다는 우려는 오클라호마 시 지역 사회 활동가인 아우렐리우스 프란시스코가 AP에서 알게 된 새로운 도구에 대해 “매우 우려스러운” 점 중 일부에 불과합니다.

그는 이러한 보고서를 자동화하면 “경찰이 지역 사회 구성원을 괴롭히고, 감시하고, 폭력을 가하는 능력을 완화할 것”이라고 말했습니다. 경찰의 업무를 더 쉽게 만들지만, 흑인과 유색인종의 삶을 더 어렵게 만듭니다.